update code

Showing

.gitignore

0 → 100644

.pre-commit-config.yaml

0 → 100644

.style.yapf

0 → 100644

.travis.yml

0 → 100644

LICENSE

0 → 100644

This diff is collapsed.

README_cn.md

0 → 100644

This diff is collapsed.

README_en.md

0 → 100644

This diff is collapsed.

32.2 KB

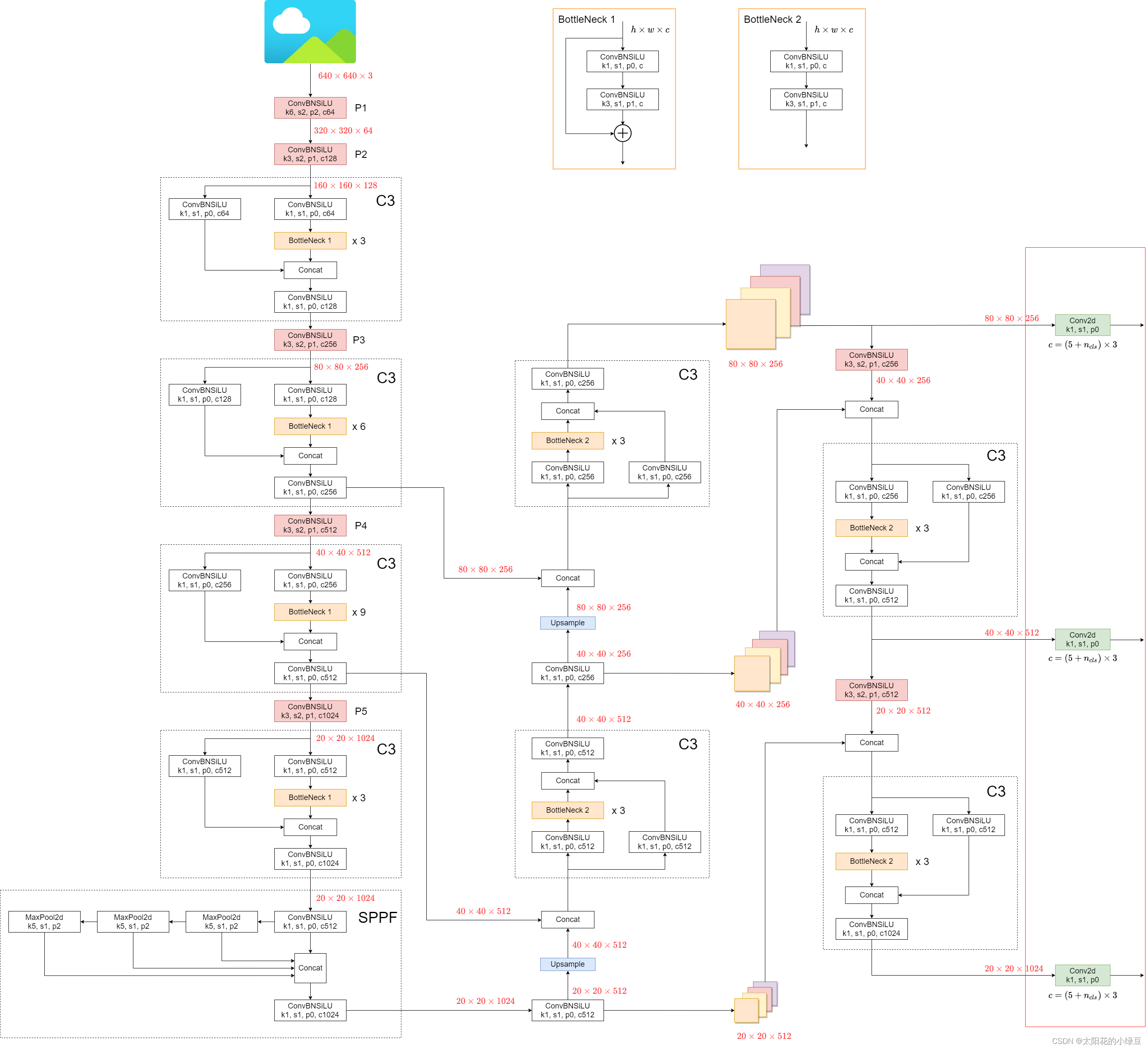

asserts/Backbone.png

0 → 100644

379 KB

asserts/model.properties

0 → 100644

273 KB

configs/datasets/voc.yml

0 → 100644

configs/runtime.yml

0 → 100644

configs/yolov5/README.md

0 → 100644