Skip to content

GitLab

Menu

Projects

Groups

Snippets

Loading...

Help

Help

Support

Community forum

Keyboard shortcuts

?

Submit feedback

Contribute to GitLab

Sign in / Register

Toggle navigation

Menu

Open sidebar

chenzk

bert4torch_pytorch

Commits

addc6376

Commit

addc6376

authored

Oct 11, 2023

by

yangzhong

Browse files

update image

parent

709a786a

Changes

1

Hide whitespace changes

Inline

Side-by-side

Showing

1 changed file

with

2 additions

and

4 deletions

+2

-4

README.md

README.md

+2

-4

No files found.

README.md

View file @

addc6376

...

@@ -13,8 +13,7 @@ BERT的主模型是BERT中最重要组件,BERT通过预训练(pre-training

...

@@ -13,8 +13,7 @@ BERT的主模型是BERT中最重要组件,BERT通过预训练(pre-training

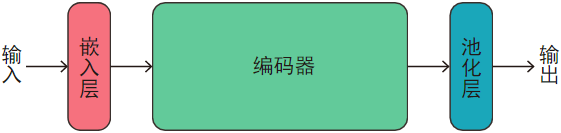

主模型由三部分构成:

**嵌入层**

、

**编码器**

、

**池化层**

。

主模型由三部分构成:

**嵌入层**

、

**编码器**

、

**池化层**

。

如图:

如图:

其中

其中

...

@@ -30,8 +29,7 @@ BERT模型是基于Transformer模型的,但是与原始的Transformer模型不

...

@@ -30,8 +29,7 @@ BERT模型是基于Transformer模型的,但是与原始的Transformer模型不

-

预训练(pre-training):先对大量语料进行无监督学习;

-

预训练(pre-training):先对大量语料进行无监督学习;

-

微调(Fine-tuning):再对少量标注语料进行监督学习,提升模型针对特定任务的表现能力。

-

微调(Fine-tuning):再对少量标注语料进行监督学习,提升模型针对特定任务的表现能力。

## 环境配置

## 环境配置

...

...

Write

Preview

Markdown

is supported

0%

Try again

or

attach a new file

.

Attach a file

Cancel

You are about to add

0

people

to the discussion. Proceed with caution.

Finish editing this message first!

Cancel

Please

register

or

sign in

to comment