Initial commit

parents

Showing

README.md

0 → 100644

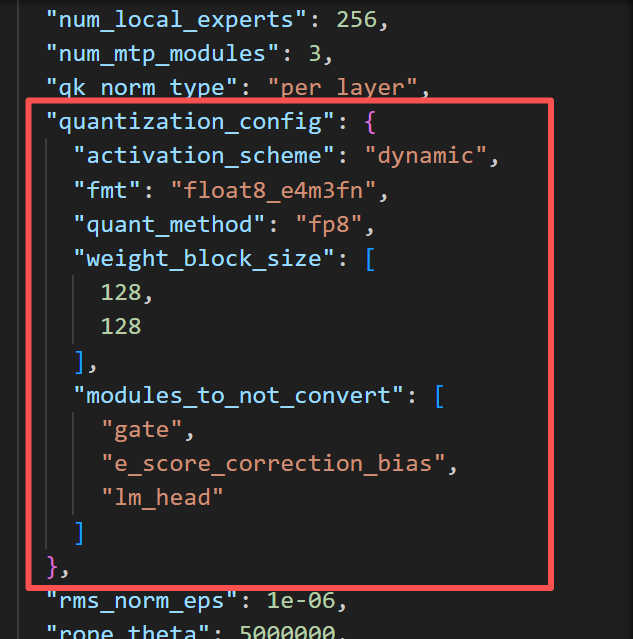

doc/quant.png

0 → 100644

57.2 KB

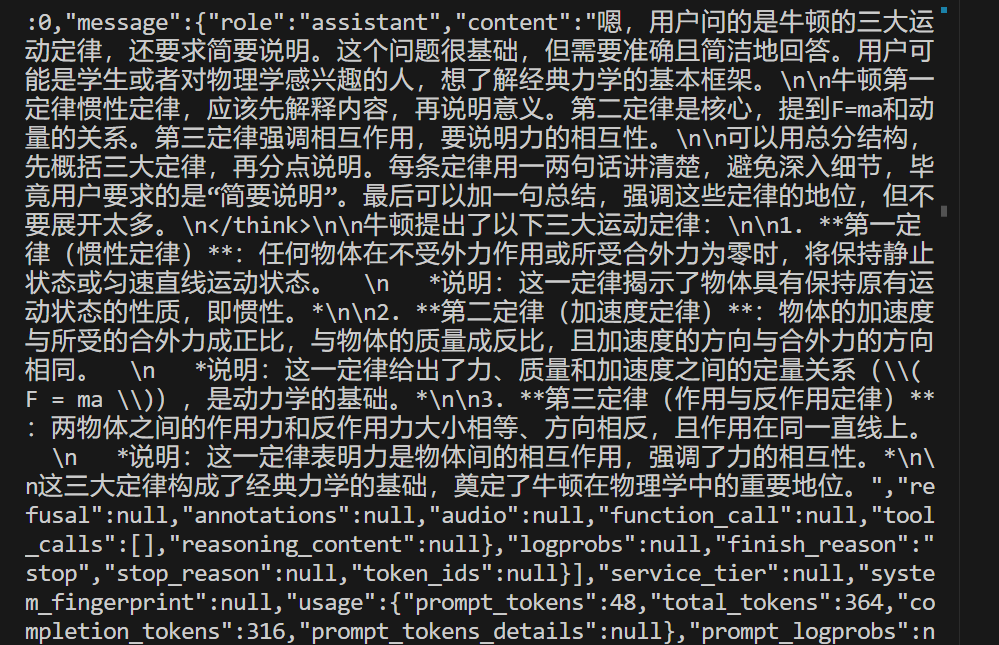

doc/result-dcu.png

0 → 100644

206 KB

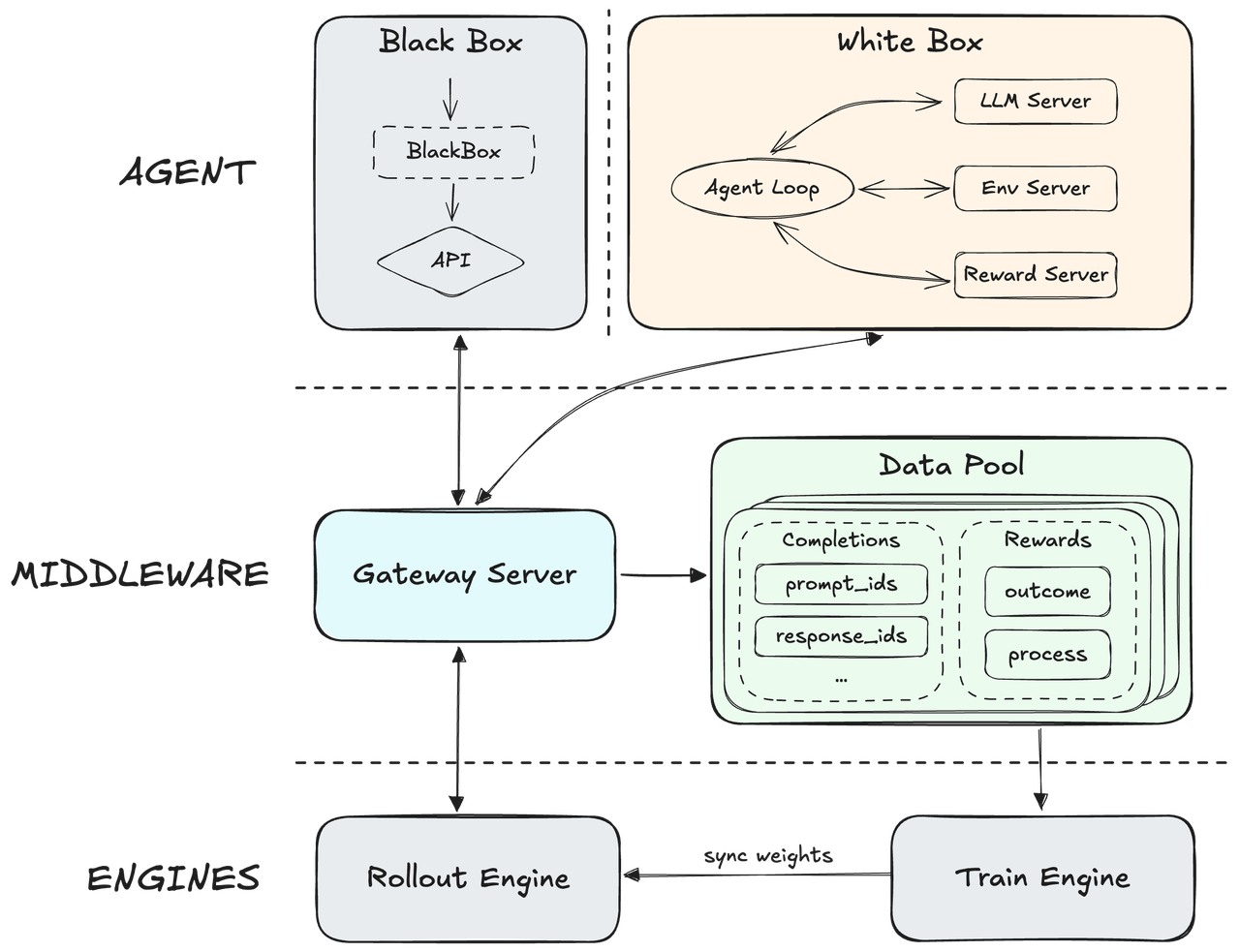

doc/rl_1.png

0 → 100644

329 KB

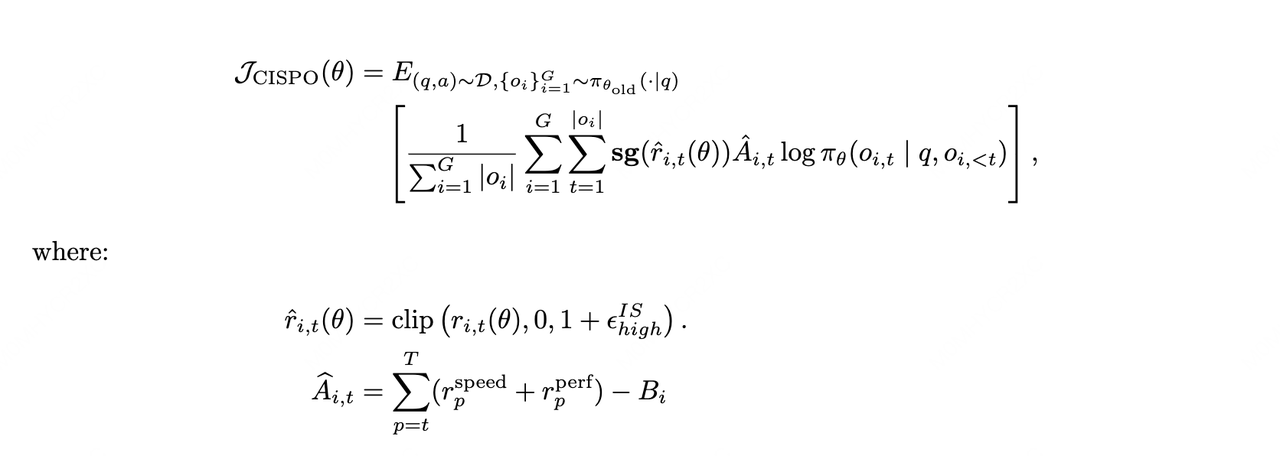

doc/rl_2.png

0 → 100644

69.4 KB

icon.png

0 → 100644

72.7 KB

model.properties

0 → 100644

File added