No commit message

No commit message

Showing

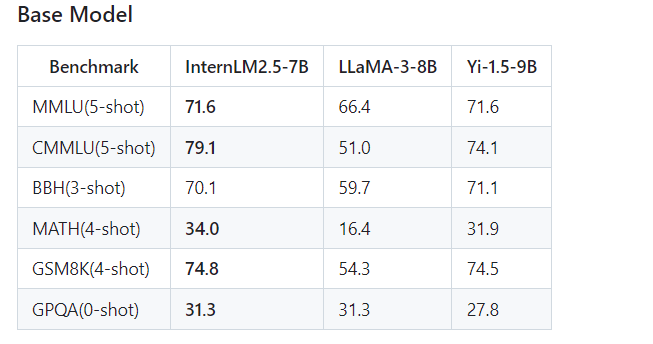

doc/eval1.png

0 → 100644

24.3 KB

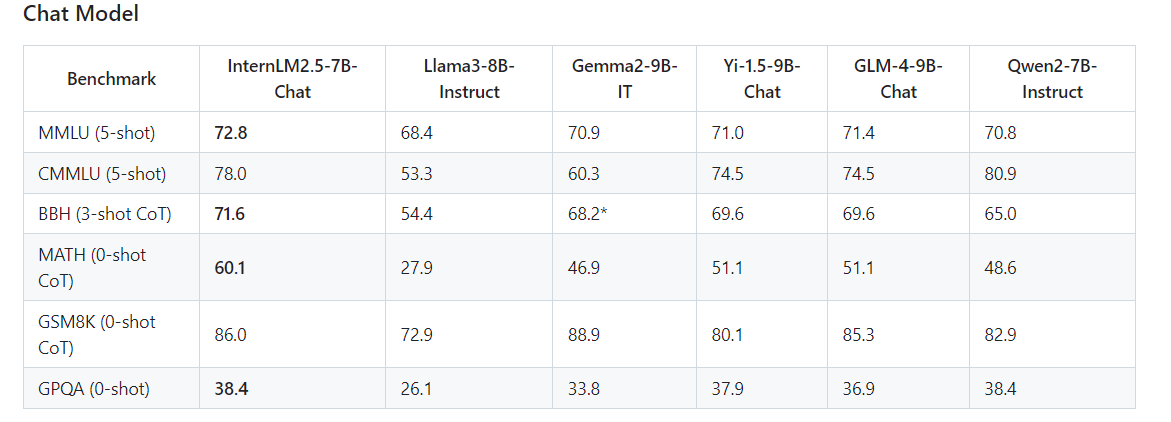

doc/eval2.png

0 → 100644

39.9 KB

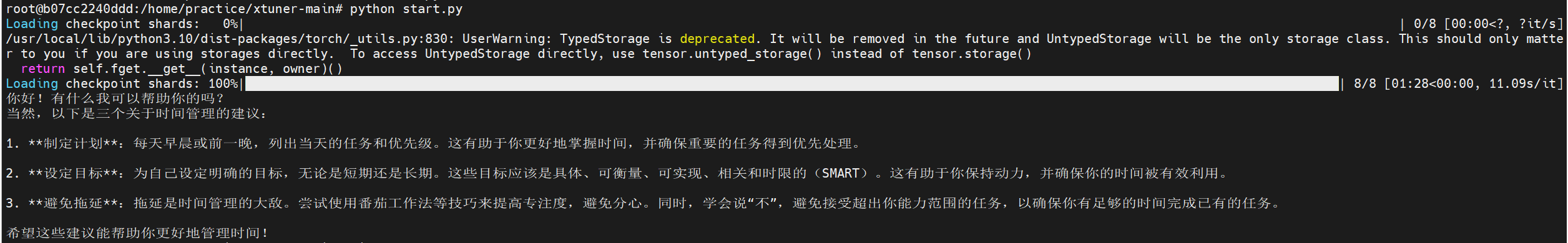

doc/res.png

0 → 100644

105 KB

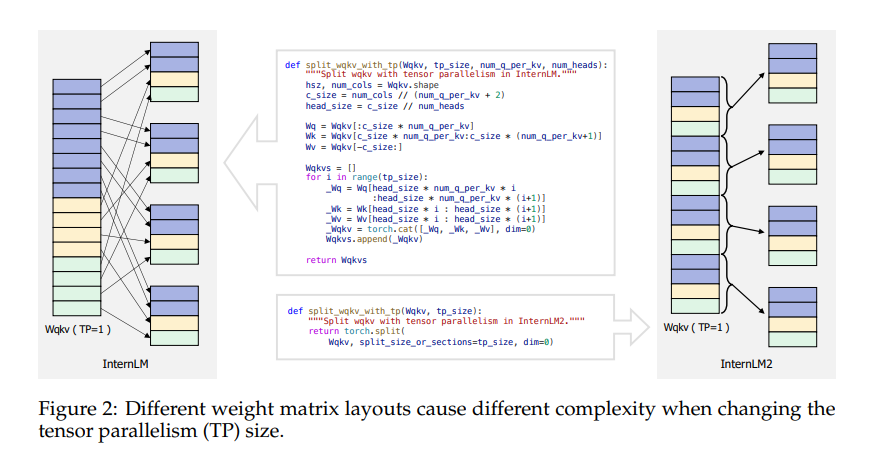

doc/struct.png

0 → 100644

101 KB

No commit message

24.3 KB

39.9 KB

105 KB

101 KB