Merge branch 'dygraph' into fix_prepare

Showing

doc/PaddleOCR_log.png

0 → 100644

75.5 KB

80.1 KB

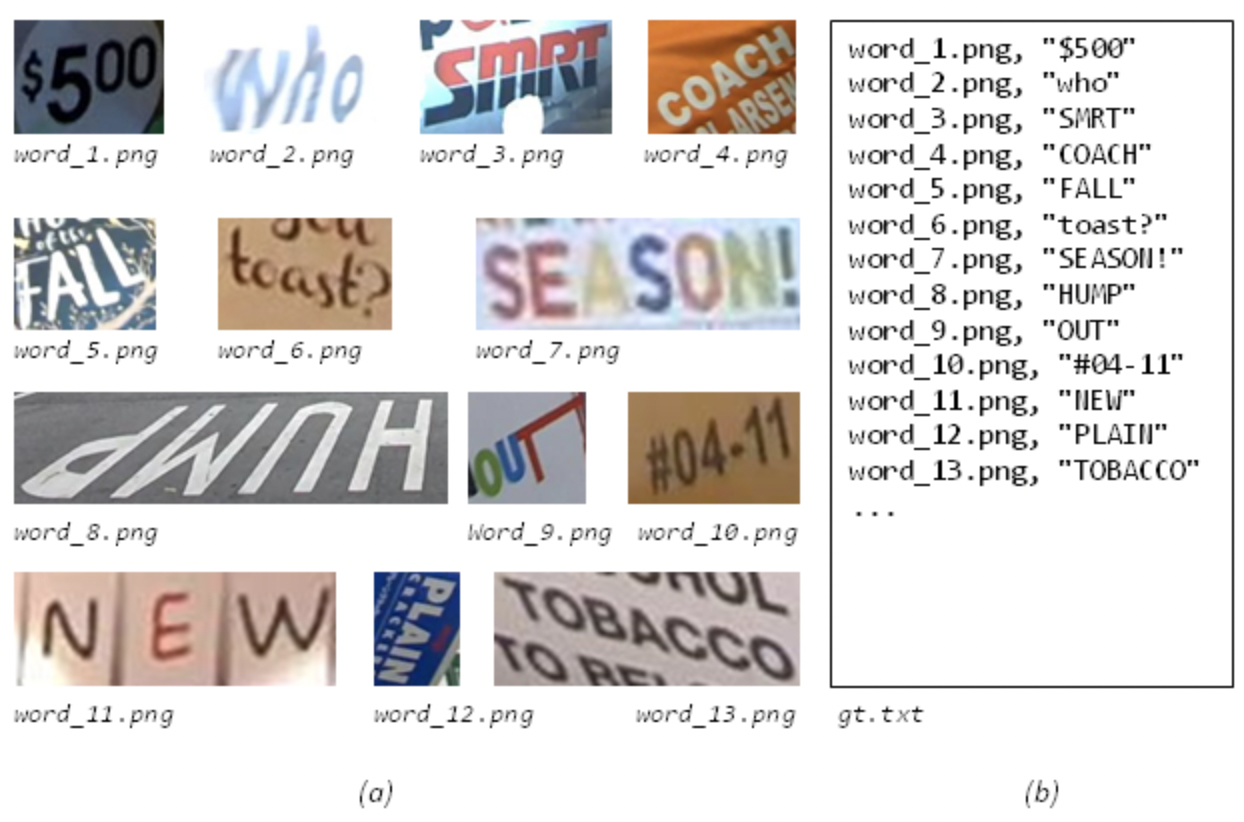

doc/datasets/icdar_rec.png

0 → 100644

921 KB

This diff is collapsed.

doc/doc_ch/environment.md

0 → 100644