VLMEvalKit: 一种多模态大模型评测工具

[![][github-contributors-shield]][github-contributors-link] • [![][github-forks-shield]][github-forks-link] • [![][github-stars-shield]][github-stars-link] • [![][github-issues-shield]][github-issues-link] • [![][github-license-shield]][github-license-link]

[English](/README.md) | 简体中文 | [日本語](/docs/ja/README_ja.md)

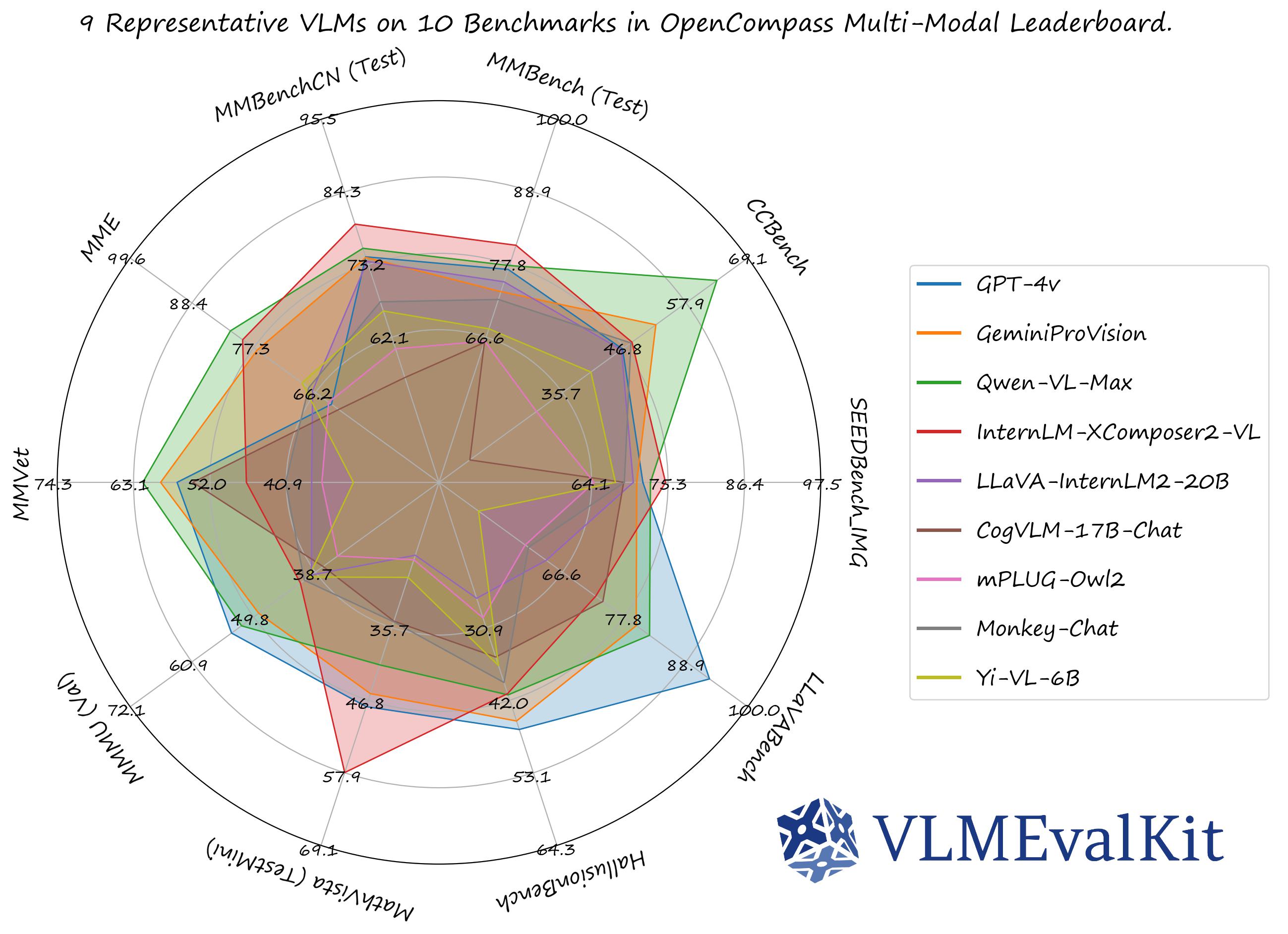

🏆 OpenCompass 排行榜 •

📊 数据集和模型 •

🏗️ 快速开始 •

🛠️ 开发指南 •

🎯 我们的目标 •

🖊️ 引用

🤗 HuggingFace 排行榜 (存档全部性能) •

🤗 原始评测记录 •

🔊 Discord •

📝 技术报告